ALFA Comfort 168A-02 отзывы, видео обзор, характеристики, описание

- Главная страница

- >

- Сигнализация

- >

- ALFA Comfort 168A-02

Описание

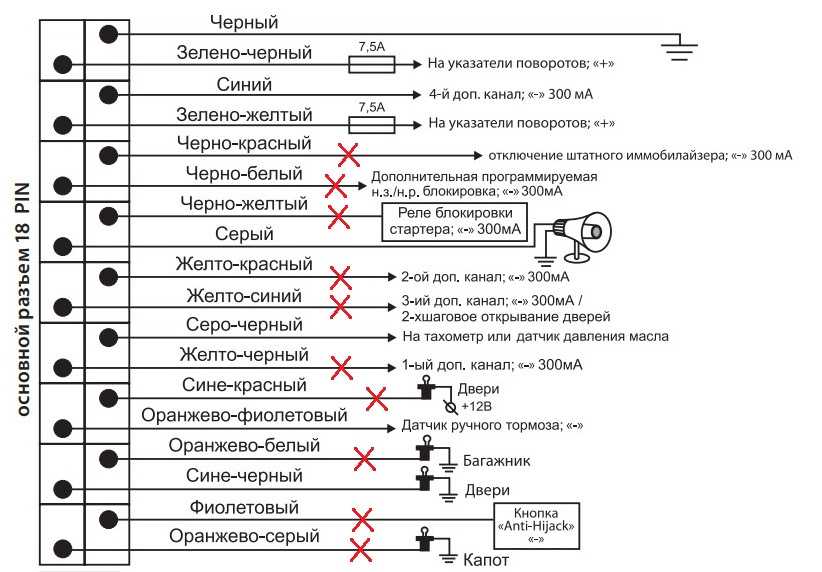

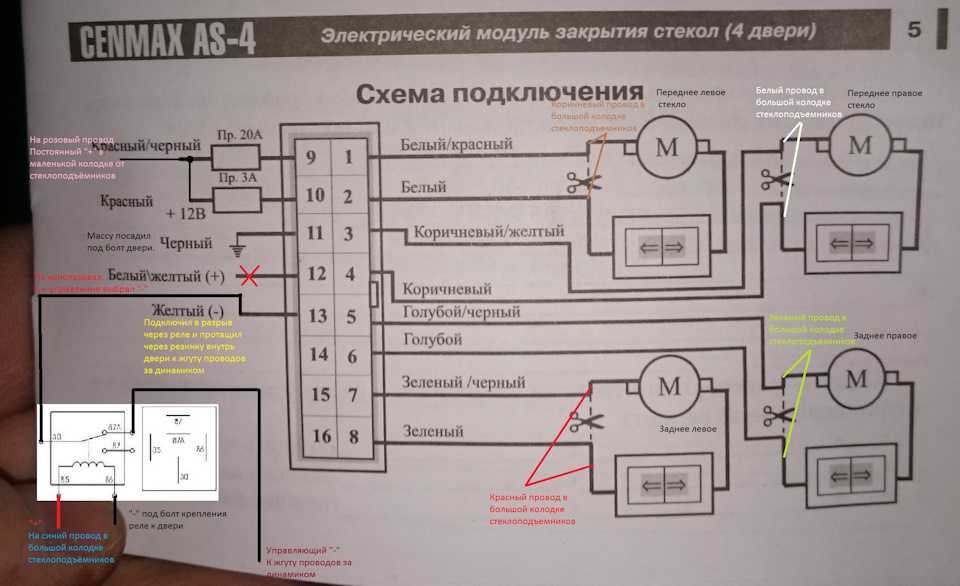

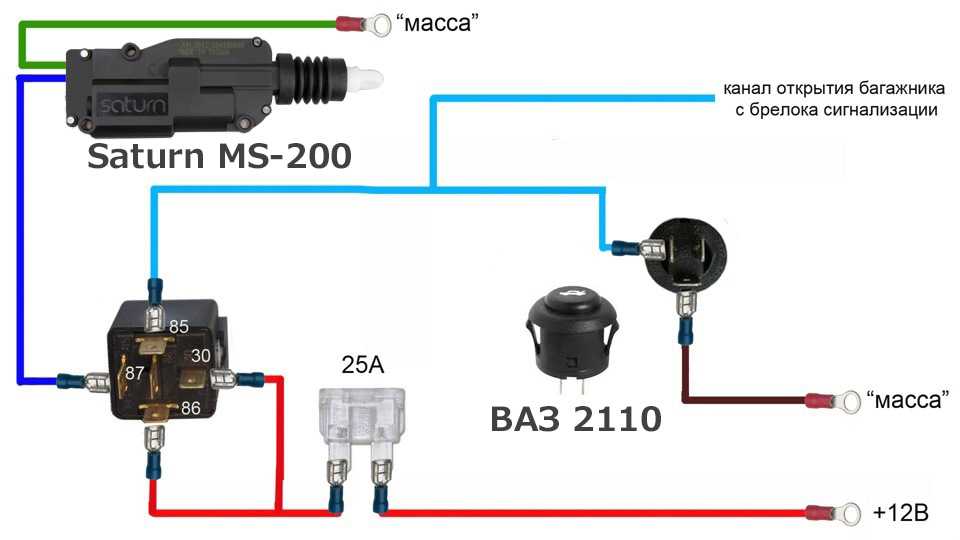

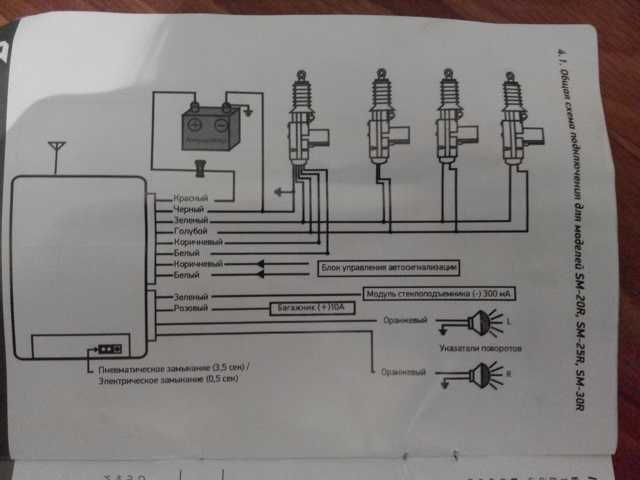

Модуль дистанционного управления Alfa Comfort предназначен для дистанционного управления центральным замком, электроподъёмниками и багажником автомобиля.

Система может быть установлена на любое транспортное средство с напряжением питающей сети 12V. Управление модулем производится дистанционно с брелка по радиоканалу на разрешенной частоте 433,97 Мгц.

Отзывы

alexxxxx

Периодически вдруг начинает клацать замками!

ПосредственноПоставил пару месяцев назад чтобы управлять центральным замком. Недолго он нормально работал…

Ни с того ни с сего при нажатии на кнопку периодически начинает клацать замками: открывать-закрывать их по нескольку раз. Теперь если закрываешь машину – не знаешь в итоге закрыл или нет! Приходится как раньше ключом.

В общем, прогадал с ним! Дешево. Периодически сам открывается!..

Недолго он нормально работал…

Ни с того ни с сего при нажатии на кнопку периодически начинает клацать замками: открывать-закрывать их по нескольку раз. Теперь если закрываешь машину – не знаешь в итоге закрыл или нет! Приходится как раньше ключом.

В общем, прогадал с ним! Дешево. Периодически сам открывается!..Archik18

Бюджетное решение

ХорошоОтличный модуль комфорта. Установка заняла минут 20, все необходимое есть в комплекте, два брелка. Один брелок, он же болванка выкидного ключа, очень удобно. Рекомендую, как очень бюджетный вариант. 1. Цена 2. Простота установки Пока нетarhipus

возможный геморой за минимум денег.

Ужасно!Вещь хорошая, стоит минимум, поставить для управления замками сможет любой человек маломальски знакомый с электрикой. Минус один и единственный. открывается любым кодграббером. как и любая сигналка с кейлог кодом. Минимум в салоне забирается все ценное. максимум машина . Цена. Простота. Простота, уязвимость против кодграббера.

Минус один и единственный. открывается любым кодграббером. как и любая сигналка с кейлог кодом. Минимум в салоне забирается все ценное. максимум машина . Цена. Простота. Простота, уязвимость против кодграббера.Bull 23

За эти деньги вполне не плохо.

ХорошоПокупал сей девайс около 2-х недель назад. Свои функции этот блок управления ц/з выполняет полностью. И больше от него хотеть нечего. Установка в авто проста, и занимает 1-1.5 часа. Если не разбираетесь сами, обратитесь к электрику. Стоит сие удовольствие 20$. Да, провода могли быть и по длиннее, но ничего не мешает самому наростить кусочек (что и было сделано). Свои функции выполняет без нареканий. Коротковаты провода.Oleg_Sergeevich

Возможность самостоятельной установки и простота управления

Отлично!Приобрел себе Alfa Comfort месяц назад, автомобиль Пассат В-5. Нужно было просто открывать, закрывать центральный замок, хотел обратиться к установщикам и установить (работа стоит где-то 20 долларов), но посмотрел схему и справился сам. Сей девайс прост до ужаса, пришлось подсоединить +,массу, повороты и дожим стекол (как опция можно было и не подключать, но работает отлично), и сами замки, цвета проводов и как подсоединить посмотрел в нете, время ушло 3 часа и 1,5литра пива в субботу. Возможность самостоятельной установки и простота управления Жалко, что второй брелок-ключ, который в комплекте, не раскладушка

Нужно было просто открывать, закрывать центральный замок, хотел обратиться к установщикам и установить (работа стоит где-то 20 долларов), но посмотрел схему и справился сам. Сей девайс прост до ужаса, пришлось подсоединить +,массу, повороты и дожим стекол (как опция можно было и не подключать, но работает отлично), и сами замки, цвета проводов и как подсоединить посмотрел в нете, время ушло 3 часа и 1,5литра пива в субботу. Возможность самостоятельной установки и простота управления Жалко, что второй брелок-ключ, который в комплекте, не раскладушкаseny

Блок управления ЦЗ

ХорошоСломался ключ и нужен был простой блок управления ЦЗ. Выбирал между Альфой и Томогавком, в итоге выбрал цену. Поставил сам – все просто, чуть-чуть не хватило штатного провода до точки подключения “земли”; также из-за короткого провода (где-то 1-1,3 м.) светодиод поставил в ближайшем углу.

wolfzz1

Отлично

Отлично!Сам устанавливал такую, но имею опыт по электрике. Поэтому проблем не было. Рекомендую устанавливать блок на расстоянии от мощных силовых цепей и других блоков, антенну распрямить и вытянуть в районе торпеды около лобового стекла или боковой стойки, это увеличит дальность, следует помнить, что это электроника и не для военного применения , а следовательно не защищена от помех и не имеет диалогового кода. По поводу глюка, (клацание замков) , это может быть штатные механические переключатели управления в передних дверях, бывает только в левой двери. Можно еще попробовать по новой привязать брелки. В целом система отличная сделана не хуже шерифа или томагавка, плата из стеклотекстолита, прочная, пайка отличная, элементы хорошего качества. За эту цену неплохо. Цена, качество изготовления. прочные брелки. Простота. Гарантия. Сэкономили на длине проводов, но это не проблема.

Можно еще попробовать по новой привязать брелки. В целом система отличная сделана не хуже шерифа или томагавка, плата из стеклотекстолита, прочная, пайка отличная, элементы хорошего качества. За эту цену неплохо. Цена, качество изготовления. прочные брелки. Простота. Гарантия. Сэкономили на длине проводов, но это не проблема.Обратите внимание

Sheriff ZX-750

Средняя оценка: 3.5, мнений:

A.P.S. 3900

Средняя оценка: 5, мнений:

Tomahawk Z1

Средняя оценка: 4.5, мнений:

Pantera KL-1

Средняя оценка: 4.5, мнений:

Расскажите друзьям

Выскажите своё мнение

Alfa comfort в Подольске: 552-товара: бесплатная доставка [перейти]

Партнерская программаПомощь

Подольск

Каталог

Каталог Товаров

Одежда и обувь

Одежда и обувь

Стройматериалы

Стройматериалы

Здоровье и красота

Здоровье и красота

Детские товары

Детские товары

Текстиль и кожа

Текстиль и кожа

Продукты и напитки

Продукты и напитки

Дом и сад

Дом и сад

Электротехника

Электротехника

Сельское хозяйство

Сельское хозяйство

Мебель и интерьер

Мебель и интерьер

Вода, газ и тепло

Вода, газ и тепло

Все категории

ВходИзбранное

Alfa comfort

118 180

Газовый котел ACV Alfa Comfort 40

ПОДРОБНЕЕЕще цены и похожие товары

385 878

Котел газовый ACV Alfa Comfort E 90 (90,5 кВт) (напольный, одноконтурный, дымоход) (04531518)

ПОДРОБНЕЕЕще цены и похожие товары

213 982

Котёл напольный ACV Alfa Comfort E 75 04531516 Производитель: ACV, Макс. тепловая мощность: 71 кВт,

тепловая мощность: 71 кВт,

ПОДРОБНЕЕЕще цены и похожие товары

134 649

Газовый котел ACV Alfa Comfort E 60 v16 Производитель: ACV, Тип отопительного котла: газовый, Макс.

ПОДРОБНЕЕЕще цены и похожие товары

161 943

Газовый котел ACV Alfa Comfort E 65 v16 Производитель: ACV, Тип отопительного котла: газовый

ПОДРОБНЕЕЕще цены и похожие товары

126 643

Alfa Comfort E 40 ACV Напольный газовый котел ACV Alfa Comfort E 40 Производитель: ACV, Тип

ПОДРОБНЕЕЕще цены и похожие товары

Вентилятор накладной D100 COMFORT Рабочий механизм: осевой

ПОДРОБНЕЕЕще цены и похожие товары

257 063

Газовый котел ACV Alfa Comfort E 95 v15 (90,5 кВт) Производитель: ACV, Тип отопительного котла:

ПОДРОБНЕЕЕще цены и похожие товары

85 800

Газовый котел ACV Alfa Comfort 40 v16 32 кВт одноконтурный Производитель: ACV, Тип отопительного

ПОДРОБНЕЕЕще цены и похожие товары

105 536

Газовый котел ACV Alfa Comfort E 40 v16 Производитель: ACV, Тип отопительного котла: газовый, Макс.

ПОДРОБНЕЕЕще цены и похожие товары

243 824

Газовый котел ACV Alfa Comfort E 95 v15 Производитель: ACV, Тип отопительного котла: газовый, Макс.

ПОДРОБНЕЕЕще цены и похожие товары

124 458

Котёл напольный ACV Alfa Comfort 40 04531502 Производитель: ACV, Макс. тепловая мощность: 32кВт,

ПОДРОБНЕЕЕще цены и похожие товары

595 356

Газовый котел ACV Alfa Comfort E 95 v15 (90,5 кВт) 04531518 Производитель: ACV, Тип отопительного

ПОДРОБНЕЕЕще цены и похожие товары

99 400

Газовый котел ACV Alfa Comfort 50 v16 42 кВт одноконтурный Производитель: ACV, Тип отопительного

ПОДРОБНЕЕЕще цены и похожие товары

103 716

Газовый котел ACV Alfa Comfort 40 v15 Производитель: ACV, Тип отопительного котла: газовый

ПОДРОБНЕЕЕще цены и похожие товары

209 000

ACV Alfa Comfort Е электрозависимый отопительный газовый котел Производитель: ACV, Тип

ПОДРОБНЕЕЕще цены и похожие товары

194 330

Котёл напольный ACV Alfa Comfort E 65 04531515 Производитель: ACV, Макс. тепловая мощность: 61 кВт,

тепловая мощность: 61 кВт,

ПОДРОБНЕЕЕще цены и похожие товары

163 761

Котёл напольный ACV Alfa Comfort 60 04531504 Производитель: ACV, Макс. тепловая мощность: 52 кВт,

ПОДРОБНЕЕЕще цены и похожие товары

126 643

Газовый котел ACV Alfa Comfort E 40 v15 Производитель: ACV, Тип отопительного котла: газовый

ПОДРОБНЕЕЕще цены и похожие товары

124 459

Отопительный котел ACV Alfa Comfort 40 (32 кВт) Производитель: ACV, Макс. тепловая мощность: 32

ПОДРОБНЕЕЕще цены и похожие товары

144 111

Отопительный котел ACV Alfa Comfort 50 (42 кВт) Производитель: ACV, Макс. тепловая мощность: 42

ПОДРОБНЕЕЕще цены и похожие товары

292 588

ACV Alfa Comfort Е 95 Чугунный котел Производитель: ACV

ПОДРОБНЕЕЕще цены и похожие товары

94 618

Газовый котел ACV Alfa Comfort E 30 v16 Производитель: ACV, Тип отопительного котла: газовый

ПОДРОБНЕЕЕще цены и похожие товары

292 589

Alfa Comfort E 95 v15 ACV Напольный газовый котел отопления ACV Alfa Comfort E 95 v15 (90,5 кВт)

ПОДРОБНЕЕЕще цены и похожие товары

2 страница из 9

Быстрый старт — Документация Yellowbrick v1.

5

5Если вы новичок в Yellowbrick, это руководство поможет вам начать работу и включить визуализаторы в рабочий процесс машинного обучения. Однако прежде чем мы начнем, необходимо сделать несколько замечаний о средах разработки.

Yellowbrick имеет две основные зависимости: scikit-learn и matplotlib. Если у вас нет этих пакетов Python, они будут установлены вместе с Yellowbrick. Обратите внимание, что Yellowbrick лучше всего работает с scikit-learn версии 0.20 или новее и matplotlib версии 3.0.1 или новее. Оба этих пакета требуют компиляции некоторого кода C, что может быть сложно в некоторых системах, таких как Windows. Если у вас возникли проблемы, попробуйте использовать дистрибутив Python, включающий такие пакеты, как Anaconda.

Yellowbrick также обычно используется внутри Jupyter Notebook вместе с фреймами данных Pandas. Ноутбуки особенно упрощают координацию кода и визуализаций; однако вы также можете использовать Yellowbrick внутри обычных скриптов Python, сохраняя цифры на диск или показывая цифры в окне графического интерфейса. Если у вас возникли проблемы с этим, обратитесь к документации по бэкэндам matplotlib.

Если у вас возникли проблемы с этим, обратитесь к документации по бэкэндам matplotlib.

Примечание

Jupyter, Pandas и другие вспомогательные библиотеки, такие как Natural Language Toolkit (NLTK) для текстовых визуализаторов, не устанавливаются вместе с Yellowbrick и должны устанавливаться отдельно.

Установка

Yellowbrick — это пакет Python 3, который хорошо работает с 3.4 и более поздними версиями. Самый простой способ установить Yellowbrick — из PyPI с помощью pip, предпочтительного установщика пакетов Python.

$ pip установить желтый кирпич

Обратите внимание, что Yellowbrick является активным проектом и регулярно публикует новые выпуски с большим количеством визуализаторов и обновлений. Чтобы обновить Yellowbrick до последней версии, используйте pip следующим образом.

$ pip install -U желтый кирпич

Вы также можете использовать флаг -U для обновления scikit-learn, matplotlib или любых других сторонних утилит, которые хорошо работают с Yellowbrick, до их последних версий.

Если вы используете Anaconda, вы можете воспользоваться утилитой conda для установки пакета Anaconda Yellowbrick:

conda install -c Districtdatalabs желтый кирпич

Если у вас возникли проблемы с установкой, сообщите нам об этом на GitHub.

После установки вы сможете импортировать Yellowbrick без ошибок как в Python, так и внутри блокнотов Jupyter. Обратите внимание, что из-за matplotlib Yellowbrick не работает внутри виртуальной среды на macOS без прыжков через некоторые обручи.

Использование желтого кирпича

API Yellowbrick специально разработан для взаимодействия с scikit-learn. Таким образом, основным интерфейсом является визуализатор — объект, который обучается на основе данных для создания визуализации. Визуализаторы являются объектами оценки scikit-learn и имеют аналогичный интерфейс вместе с методами рисования. Чтобы использовать визуализаторы, вы просто используете тот же рабочий процесс, что и с моделью scikit-learn, импортируете визуализатор, создаете его экземпляр, вызываете fit() , затем для визуализации визуализации вызовите метод show() визуализатора.

Например, есть несколько визуализаторов, которые действуют как преобразователи, используемые для выполнения анализа признаков перед подгонкой модели. Следующий пример визуализирует многомерный набор данных с параллельными координатами:

.из yellowbrick.features импортировать ParallelCoordinates визуализатор = ПараллельныеКоординаты() визуализатор.fit_transform(Х, у) визуализатор.show()

Как видите, рабочий процесс очень похож на использование преобразователя scikit-learn, а визуализаторы предназначены для интеграции вместе с утилитами scikit-learn. Аргументы, которые изменяют способ отрисовки визуализации, могут быть переданы визуализатору при создании экземпляра, аналогично тому, как гиперпараметры включаются в модели scikit-learn.

Метод show() завершает рисование (добавляет заголовки, метки осей и т. д.), а затем визуализирует изображение от вашего имени. Если вы находитесь в блокноте Jupyter, изображение должно просто появиться в выводе блокнота.

визуализатор.show(outpath="pcoords.png")

Расширение имени файла будет определять способ визуализации изображения. В дополнение к расширению .png , .pdf также обычно используется для высококачественных изображений, готовых к публикации.

Примечание

Ввод данных в Yellowbrick идентичен вводу scikit-learn. Наборы данных

обычно описывается переменной X (иногда называемой просто данными) и дополнительной переменной y (обычно называется целью). Требуемые данные X — это таблица, содержащая экземпляры (или выборки), которые описываются функциями. Таким образом, (n, m) , где n — количество экземпляров (строк), а m — количество признаков (столбцов).

X может быть DataFrame Pandas, массивом NumPy или даже списками списков Python.

Необязательные целевые данные, y используется для указания истинности в контролируемом машинном обучении. y — это вектор (одномерный массив), который должен иметь длину n — столько же элементов, сколько строк в X . y может быть серией Pandas, массивом Numpy или списком Python.

Визуализаторы также могут включать в себя модели scikit-learn для оценки, настройки гиперпараметров и выбора алгоритма. Например, чтобы создать визуальную тепловую карту отчета о классификации, отображающую точность, полноту, оценку F1 и поддержку для каждого класса в классификаторе, поместите оценщик в визуализатор следующим образом:0003

из yellowbrick.classifier import ClassificationReport из sklearn.linear_model импортировать LogisticRegression модель = Логистическая регрессия () визуализатор = Отчет о классификации (модель) visualizer.fit(X_train, y_train) визуализатор.score(X_test, y_test) визуализатор.show()

Требуются только две дополнительные строки кода для добавления визуальной оценки модели классификатора, создания экземпляра визуализатора ClassificationReport , который обертывает оценщик классификации, и вызова его .0019 метод show() . Таким образом, визуализаторы улучшают рабочий процесс машинного обучения, не прерывая его.

API на основе классов предназначен для прямой интеграции с scikit-learn, однако иногда бывают случаи, когда вам просто нужна быстрая визуализация. Yellowbrick поддерживает быстрые функции для непосредственного использования этого преимущества. Например, две визуальные диагностики можно было бы вместо этого реализовать следующим образом:

из импорта sklearn.linear_model LogisticRegression из yellowbrick.features импортировать parallel_coordinates из yellowbrick.classifier импортаclassification_report # Отображает параллельные координаты g = параллельные_координаты (X, y) # Отображает отчет о классификации g = отчет_классификации (логистическая регрессия (), X, y)

Эти быстрые функции дают вам немного меньший контроль над рабочим процессом машинного обучения, но быстро предоставляют вам диагностику по запросу и очень полезны в исследовательских процессах.

Прохождение

Рассмотрим регрессионный анализ как простой пример использования визуализаторов в рабочем процессе машинного обучения. Используя набор данных о совместном использовании велосипедов, основанный на наборе данных, загруженном в репозиторий машинного обучения UCI, мы хотели бы предсказать количество велосипедов, арендованных в данный час, на основе таких характеристик, как сезон, погода или праздник.

Примечание

Мы обновили набор данных из репозитория UCI ML, чтобы упростить загрузку в Pandas; убедитесь, что вы загружаете версию набора данных Yellowbrick, используя метод load_bikeshare ниже. Также обратите внимание, что Pandas должен следовать предоставленному коду. Pandas можно установить с помощью pip install pandas , если вы еще не установили его.

Мы можем загрузить наши данные с помощью модуля yellowbrick.datasets следующим образом:

импортировать панд как pd из yellowbrick.datasets импортировать load_bikeshare X, y = load_bikeshare() печать (X.голова ())

Это распечатывает первую пару строк нашего набора данных, который выглядит так:

сезон год месяц час праздник будни рабочий день погода температура \ 0 1 0 1 0 0 6 0 1 0,24 1 1 0 1 1 0 6 0 1 0,22 2 1 0 1 2 0 6 0 1 0,22 3 1 0 1 3 0 6 0 1 0,24 4 1 0 1 4 0 6 0 1 0,24 похоже на влажность скорость ветра 0 0,28790,81 0,0 1 0,2727 0,80 0,0 2 0,2727 0,80 0,0 3 0,2879 0,75 0,0 4 0,2879 0,75 0,0

Рабочий процесс машинного обучения — это искусство создания троек выбора модели , комбинации функций, алгоритма и гиперпараметров, которые однозначно идентифицируют модель, соответствующую определенному набору данных. В рамках нашего выбора функций мы хотим определить функции, которые имеют линейную связь друг с другом, потенциально вводя ковариацию в нашу модель и нарушая МНК (направляя нас к удалению функций или использованию регуляризации). Мы можем использовать визуализатор Rank Features для вычисления корреляции Пирсона между всеми парами признаков следующим образом:0003

из yellowbrick.features импортировать Rank2D визуализатор = Rank2D (алгоритм = "пирсон") визуализатор.fit_transform(X) визуализатор.show()

(Исходный код, png, pdf)

На этом рисунке показана корреляция Пирсона между парами объектов, так что каждая ячейка в сетке представляет два объекта, идентифицированных по порядку на осях x и y, цвет которых отображает величину корреляции. Корреляция Пирсона 1,0 означает, что существует сильная положительная линейная связь между парами переменных, а значение -1,0 указывает на сильную отрицательную линейную связь (нулевое значение указывает на отсутствие связи). Поэтому мы ищем темно-красные и синие квадраты для дальнейшей идентификации.

На этой диаграмме мы видим, что признаки temp и по ощущениям имеют сильную корреляцию, а также что признак сезон имеет сильную корреляцию с признаком месяц . Кажется, это имеет смысл; кажущаяся температура, которую мы ощущаем снаружи, зависит от фактической температуры и других факторов качества воздуха, а время года описывается месяцем! Чтобы погрузиться глубже, мы можем использовать прямую визуализацию данных ( JointPlotVisualizer ), чтобы проверить эти отношения.

из yellowbrick.features импортировать JointPlotVisualizer визуализатор = JointPlotVisualizer (столбцы = ['temp', 'feelslike']) визуализатор.fit_transform(Х, у) визуализатор.show()

(Исходный код, png, pdf)

Этот визуализатор строит диаграмму рассеяния кажущейся температуры по оси y и фактической измеренной температуры по оси x и рисует линию наилучшего соответствия с использованием простой линейной регрессии. Кроме того, одномерные распределения показаны в виде гистограмм над осью x для температуры и рядом с осью y для ощущений. JointPlotVisualizer дает краткий обзор очень сильной положительной корреляции признаков, а также диапазона и распределения каждого признака. Обратите внимание, что оси нормализованы к промежутку между нулем и единицей, что является распространенным методом машинного обучения для уменьшения влияния одной функции на другую.

Этот график очень интересен, потому что в наборе данных есть некоторые выбросы. Эти экземпляры, возможно, потребуется удалить вручную, чтобы улучшить качество окончательной модели, поскольку они могут представлять ошибки ввода данных и потенциально обучать модель на искаженном наборе данных, который будет возвращать ненадежные прогнозы модели. Первый экземпляр выбросов возникает во временных данных, где

Первый экземпляр выбросов возникает во временных данных, где похоже, что значение примерно равно 0,25, что показывает горизонтальную строку данных, вероятно, созданную ошибкой ввода.

Мы также можем видеть, что более экстремальные температуры создают преувеличенный эффект воспринимаемой температуры; чем холоднее, тем более холодным люди, вероятно, считают это, и чем теплее, тем более теплым оно воспринимается, при этом умеренные температуры обычно мало влияют на индивидуальное восприятие комфорта. Это дает нам подсказку, что выглядит как 9.0020 может быть лучше, чем temp , обещая более стабильный набор данных с меньшим риском появления выбросов или ошибок.

В конечном итоге мы можем подтвердить предположение, обучив нашу модель на любом значении и оценив результаты. Если значение temp действительно менее надежно, мы должны удалить переменную temp в пользу по ощущениям . А пока мы будем использовать значение , похожее на из-за отсутствия выбросов и ошибок ввода.

Теперь мы можем обучить нашу модель; давайте подгоним линейную регрессию к нашей модели и построим графики остатков.

из yellowbrick.regressor import ResidualsPlot

из sklearn.linear_model импортировать линейную регрессию

из sklearn.model_selection импорта train_test_split

# Создание обучающих и тестовых наборов

X_train, X_test, y_train, y_test = train_test_split(

Х, у, test_size=0.1

)

визуализатор = график остатков (линейная регрессия ())

visualizer.fit(X_train, y_train)

визуализатор.score(X_test, y_test)

визуализатор.show()

(Исходный код, png, pdf)

График остатков показывает ошибку по сравнению с прогнозируемым значением (количество гонщиков) и позволяет нам искать гетероскедастичность в модели; например области в мишени, где ошибка наибольшая. Форма остатков может четко сообщить нам, где OLS (обычный метод наименьших квадратов) наиболее сильно зависит от компонентов нашей модели (функций). В этом случае мы видим, что меньшее прогнозируемое количество гонщиков приводит к меньшей ошибке модели, и наоборот, чем большее прогнозируемое количество гонщиков приводит к большей ошибке модели. Это указывает на то, что наша модель имеет больше шума в определенных областях цели или что две переменные коллинеарны, а это означает, что они вносят ошибку по мере изменения шума в их отношениях.

Это указывает на то, что наша модель имеет больше шума в определенных областях цели или что две переменные коллинеарны, а это означает, что они вносят ошибку по мере изменения шума в их отношениях.

График остатков также показывает, как модель вводит ошибку, жирная горизонтальная линия на остатках = 0 не является ошибкой, а любая точка выше или ниже этой линии указывает на величину ошибки. Например, большинство остатков отрицательны, и, поскольку оценка вычисляется как фактическое — ожидаемое , это означает, что ожидаемое значение большую часть времени больше фактического значения; например что наша модель в первую очередь угадывает больше, чем фактическое количество гонщиков. Кроме того, в правом верхнем углу графика остатков есть очень интересная граница, указывающая на интересный эффект в модельном пространстве; возможно, что какой-то признак сильно взвешен в области этой модели.

Наконец, остатки окрашиваются обучающим и тестовым набором. Это помогает нам выявлять ошибки при создании разбиений поездов и тестов. Если ошибка теста не соответствует ошибке поезда, то наша модель либо переобучена, либо недообучена. В противном случае может возникнуть ошибка при перетасовке набора данных перед созданием разбиений.

Это помогает нам выявлять ошибки при создании разбиений поездов и тестов. Если ошибка теста не соответствует ошибке поезда, то наша модель либо переобучена, либо недообучена. В противном случае может возникнуть ошибка при перетасовке набора данных перед созданием разбиений.

Наряду с построением графика остатков мы также измерили производительность, «оценив» нашу модель на тестовых данных, например. фрагмент кода visualizer.score(X_test, y_test) . Поскольку мы использовали модель линейной регрессии, оценка состоит из нахождения значения R-квадрата данных, которое является статистической мерой того, насколько данные близки к подобранной линии регрессии. Значение R-квадрата любой модели может немного различаться между прогонами прогнозирования/тестирования, однако в целом оно должно быть сопоставимым. В нашем случае значение R-квадрата для этой модели составляло всего 0,328, что позволяет предположить, что линейная корреляция может быть не самой подходящей для подбора этих данных. Давайте посмотрим, сможем ли мы подобрать лучшую модель, используя регуляризация и одновременно исследовать другой визуализатор.

Давайте посмотрим, сможем ли мы подобрать лучшую модель, используя регуляризация и одновременно исследовать другой визуализатор.

импортировать numpy как np из sklearn.linear_model импортировать RidgeCV из yellowbrick.regressor импортировать AlphaSelection альфа = np.logspace(-10, 1, 200) визуализатор = AlphaSelection (RidgeCV (альфа = альфа)) визуализатор.fit(X, y) визуализатор.show()

(Исходный код, png, pdf)

При изучении семейств моделей в первую очередь следует учитывать, как модель становится более сложной . По мере усложнения модели увеличивается ошибка из-за дисперсии, потому что модель становится более приспособленной и не может обобщать невидимые данные. Однако чем проще модель, тем больше вероятность ошибки из-за предвзятости; модель недоработана и поэтому чаще не попадает в цель. Таким образом, цель большей части машинного обучения состоит в том, чтобы создать модель, которая достаточно сложный , чтобы найти золотую середину между смещением и дисперсией.

Для линейной модели сложность исходит из самих признаков и их веса, присвоенного в соответствии с моделью. Таким образом, линейные модели ожидают наименьшего количества признаков , позволяющих получить объяснительный результат. Одним из способов достижения этого является регуляризация , введение параметра, называемого альфа, который нормализует веса коэффициентов относительно друг друга и снижает сложность. Альфа и сложность имеют обратную зависимость, чем выше альфа, тем ниже сложность модели и наоборот.

Следовательно, возникает вопрос, как выбрать альфу. Один из методов заключается в подборе ряда моделей с использованием перекрестной проверки и выбора альфа-канала с наименьшей ошибкой. Визуализатор AlphaSelection позволяет сделать именно это с визуальным представлением, показывающим поведение регуляризации. Как вы можете видеть на рисунке выше, ошибка уменьшается по мере увеличения значения альфа до выбранного нами значения (в данном случае 3,181), при котором ошибка начинает увеличиваться. Это позволяет нам найти компромисс между смещением и дисперсией и исследовать взаимосвязь методов регуляризации (например, Ridge vs. Lasso).

Это позволяет нам найти компромисс между смещением и дисперсией и исследовать взаимосвязь методов регуляризации (например, Ridge vs. Lasso).

Теперь мы можем обучить нашу окончательную модель и визуализировать ее с помощью визуализатора PredictionError :

из sklearn.linear_model import Ridge из yellowbrick.regressor импортировать PredictionError визуализатор = PredictionError (Хребет (альфа = 3,181)) visualizer.fit(X_train, y_train) визуализатор.score(X_test, y_test) визуализатор.show()

(Исходный код, png, pdf)

Визуализатор ошибок прогнозирования строит фактические (измеренные) и ожидаемые (прогнозированные) значения относительно друг друга. Черная пунктирная линия — это линия под углом 45 градусов, указывающая нулевую ошибку. Как и график остатков, это позволяет нам увидеть, где возникает ошибка и в каком размере.

На этом графике мы видим, что плотность большей части инстансов составляет менее 200 гонщиков. Мы можем захотеть попробовать ортогональное сопоставление или сплайны, чтобы соответствовать регрессии, которая учитывает больше региональности. Мы также можем отметить, что эта странная топология из графика остатков, по-видимому, исправлена с помощью регрессии Риджа, и что в нашей модели немного больше баланса между большими и малыми значениями. Потенциально регуляризация Риджа решила проблему ковариации между двумя функциями. По мере того, как мы продвигаемся вперед в нашем анализе с использованием других форм моделей, мы можем продолжать использовать визуализаторы для быстрого сравнения и просмотра наших результатов.

Мы также можем отметить, что эта странная топология из графика остатков, по-видимому, исправлена с помощью регрессии Риджа, и что в нашей модели немного больше баланса между большими и малыми значениями. Потенциально регуляризация Риджа решила проблему ковариации между двумя функциями. По мере того, как мы продвигаемся вперед в нашем анализе с использованием других форм моделей, мы можем продолжать использовать визуализаторы для быстрого сравнения и просмотра наших результатов.

Надеюсь, этот рабочий процесс даст вам представление о том, как интегрировать визуализаторы в машинное обучение с помощью scikit-learn, и вдохновит вас использовать их в своей работе и писать свои собственные! Для получения дополнительной информации о начале работы с Yellowbrick ознакомьтесь с учебным пособием по выбору модели. После этого вы сможете освоить определенные визуализаторы, подробно описанные в разделе Визуализаторы и API.

Модуль управления реле | Модули ввода-вывода | Системные модули | Контроллеры и панели управления | Модули ввода/вывода

- Обзор

- Технические характеристики

- Ресурсы

- Артикул

Обзор

Модуль AOM-2RF предназначен для установки в цепь сигнализации любой адресно-аналоговой панели управления пожарной сигнализацией Gamewell-FCI. Модуль управления адресным выходным реле Gamewell-FCI Velociti® позволяет аналоговой адресно-аналоговой панели управления пожарной сигнализацией Gamewell-FCI переключать дискретные релейные контакты с помощью кодовой команды. Реле имеет два изолированных набора контактов Form-C, которые переключаются одновременно. Соединения цепи с контактами реле не контролируются модулем.

Модуль управления адресным выходным реле Gamewell-FCI Velociti® позволяет аналоговой адресно-аналоговой панели управления пожарной сигнализацией Gamewell-FCI переключать дискретные релейные контакты с помощью кодовой команды. Реле имеет два изолированных набора контактов Form-C, которые переключаются одновременно. Соединения цепи с контактами реле не контролируются модулем.

Особенности и преимущества:

- Обеспечивает визуальную адресацию поворотного, десятичного переключателя (01-159)

- Включает двухцветный светодиод, который мигает зеленым при адресации модуля и горит постоянным красным при активации

- Сконструирован как компактный размер, облегчающий установку

Сертификаты:

- Перечислены в соответствии со стандартом UL 864

- UL: S1913

- FM: 3023594 Vol.-ENY

- : CO VI

- CSFM: 7300-1703:0102

- Сертификация ISO 9001

Технические характеристики

Прочее

- Максимальная рабочая влажность

- 0,93

- Конечное сопротивление линии

- 47 кО

- Ток аварийного сигнала

- 6,5 мА

- Реле тока

- 255 мкА

- Нормальный входной ток

- 255 мкА (светодиод мигает) групповой опрос

- 230 мкА (светодиод мигает) прямой опрос

- Максимальное рабочее напряжение

- 15–32 В постоянного тока

- 15 В постоянного тока

Другие

- Нормальный входной ток : 255 мкА (светодиод мигает) групповой опрос|230 мкА (светодиод мигает) прямой опрос

- Максимальная рабочая влажность : 0,93

- Сопротивление конца линии : 47 кОм

- Максимальное рабочее напряжение : 15–32 В пост.

тока|15 В пост. тока

тока|15 В пост. тока

- Ток сигнализации : 6,5 мА

- Ток реле : 255 мкА

Сорт

Другие

Название документа

Размер файла

Дата добавления

Спецификация E3 Series A и E — Сеть (DOCX)

0,08 МБ PDF)

0,35 МБ

14.06.2022

Спецификация E3 Series A и E — Автономный (DOCX)

0,08 МБ

14.06.2022 PDF)

0,35 МБ

14.06.2022

Спецификация E3 Series A и E — голосовая (DOCX)

0,08 МБ

16.06.2022

Спецификация E3 Series A и E — голосовая (PDF)

2 0 14.06.2022

Дополнение к дополнению к совместимости

0,08 МБ

15.06.2022

Продажных листов

Название документов

Размер файла

Добавлена

S3 Series Sheet Sheet

0,7999 2

S3 Series Silep

0,799992992

S3. 18.05.2022

18.05.2022

Брошюра

Заголовок документа

Размер файла

Дата добавлена

Рейтинг нагрузки.

AOM-2R Модуль управления реле Техническое описание

0,03 MB

16.08.2022

AOM-2RF Техническое описание модуля адресного вывода

0,10 MB

8/16/2023 Источники питания HP-F -2 Series

2

Техническое описание PS6 и HPF-PS10 0,23 МБ

16.08.2022

Каталог

Название документа

Размер файла

Дата добавлена

Инженерные и приложения Каталог

0,13 МБ

7/2022

Докумену. Размер

Дата добавления

AOM-2R Модуль релейного управления Техническое описание

0,03 МБ

16.08.2022

Адресный модуль вывода AOM-2RF Техническое описание

2 10/3 MB

0003

Спецификация E3 Series A и E — Сеть (DOCX)

0,08 МБ

14.06.2022

Спецификация E3 Series A и E — Сеть (PDF)

0,35 МБ

09 14.

datasets импортировать load_bikeshare

X, y = load_bikeshare()

печать (X.голова ())

datasets импортировать load_bikeshare

X, y = load_bikeshare()

печать (X.голова ())

features импортировать Rank2D

визуализатор = Rank2D (алгоритм = "пирсон")

визуализатор.fit_transform(X)

визуализатор.show()

features импортировать Rank2D

визуализатор = Rank2D (алгоритм = "пирсон")

визуализатор.fit_transform(X)

визуализатор.show()

тока|15 В пост. тока

тока|15 В пост. тока